年头,Mac Mini 一度缺货,恭候时刻致使长达一个半月。

Mac mini 是个好产物,这件事大家一直很明晰。国内渠谈价钱诚意高,M 芯片性能又好,初学配置不到三千东谈主民币就可拿下,很适邻接为创作外行的主力机。

关联词最近此次 Mac mini 爆红,跟创作或日常使用没什么关系。

温雅科技新闻的一又友们应该知谈若何回事:OpenClaw(前身叫 Clawdbot)倏得火了。

OpenClaw 有多种部署方式:你不错装到我方的电脑上,也不错单给它配一台电脑;把它部署在云霄的臆造机/沙箱环境里也没问题;自后,一些主流 AI 奇迹也推出了云霄一键部署的替代决议,权贵造谣小白玩家的门槛。

但在刚运转的那段时刻,最主流的部署决议等于单买一台 Mac mini。

情理笃定不是因为它低廉,更主要在于:要让 OpenClaw 有道理,需要给它一个「肉身」,让它探听文献、操作软件。

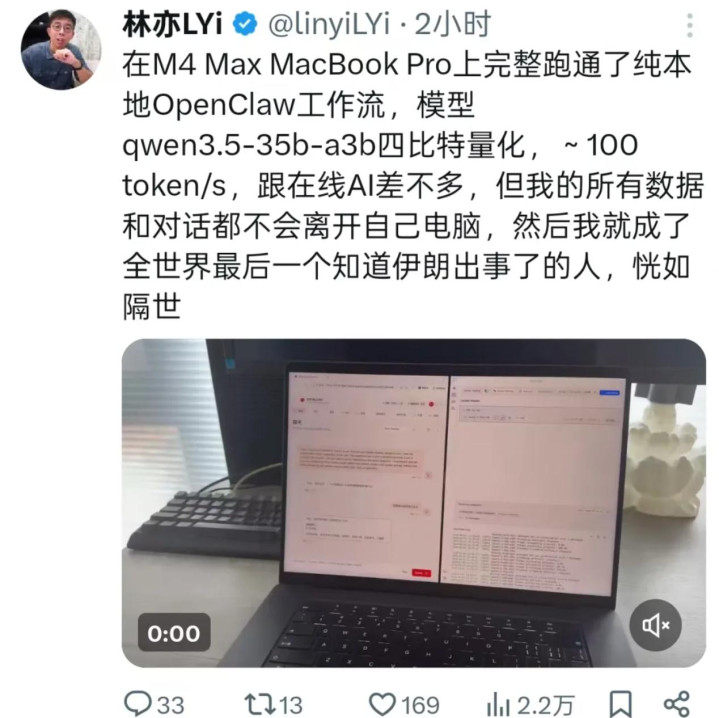

云奇迹器能运行 OpenClaw,但那仍然不是你的电脑,莫得你的文献、软件、浏览器上登录的多样账号,莫得所谓的「高下文」。Mac mini 放在桌上,7 × 24 小时无用关机,致使通过聊天机器东谈主费事操控的话都无用单配一台知道器。

给 OpenClaw 一台我方的电脑责任,惟一可不雅资本是后端接入的大模子 API 的 token 用度,好多早期玩家都在这上头吃过亏。但如果你买一台配置够高的 Mac mini,下载一个尺寸富余大的模子到土产货来运行,不错说除了电费和网费除外,简直就像得回了一个免费的劳能源……

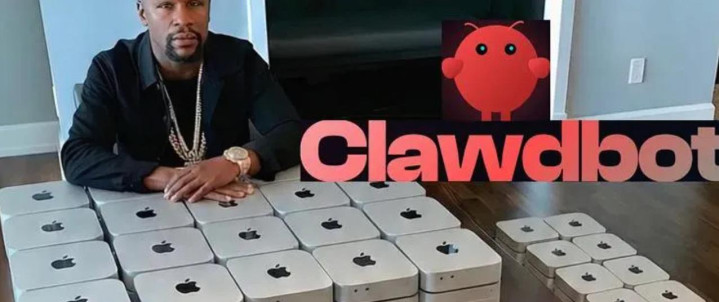

MacBook 也行,然则……

据 Tom’s Hardware 和 TechRadar 等媒体报谈,OpenClaw 走红后,Mac mini 24GB 和 32GB 配置的恭候期延至 6 天到 6 周不等;更稠密的 Mac Studio,交货时刻也从两周涨到了近两个月。

这些恭候时刻,是 OpenClaw 的早期玩家们,用真实购买投出来的票。

(注:部分机型的缺货也和苹果近期推出新款 Mac 台式机电脑研究系,以往每次推出左近新机发布时,老机型都会进入售罄气象。OpenClaw 的爆红并非惟一原因。)

冥冥之中,Mac 成为了 2026 年首选的「AI PC」;反倒是饱读励了「AI PC」好几年的 Windows PC 行业,一丝热乎的都没吃上。

英特尔、AMD、高通等芯片商,以及主流 PC 品牌们,从 2023 年就运转贩卖「AI PC」的想法了。这些最新的 Windows 电脑当中,认证过 Copilot+ PC 的比比齐是,GPU、NPU 性能并不差,有的整机价钱比 Mac 平等产物要低廉的多。

但问题是,为什么大家如故一窝风地冲向 Mac?

为什么是 Mac?

Windows PC 和 Mac 谁更好的争论,永远莫得透澈谜底。但如果限定在 AI 开采上,Mac 成为了心照不宣的选择。

天然大模子的「大脑」都在云霄奇迹器,开采者的手却都在 Mac 上。这跟 Mac 电脑的外形和操作体验关系不大:macOS 流着 UNIX 的血液,才是谬误。

AI Agent 的中枢责任是操作文献、调用号令行器用、诊疗 API 致使适度图形界面等。说的更直白一丝,Agent 等于一个智能且自动化的「剧本工程师」,仅仅剧本由大谈话模子实时生成。而 macOS 属于类 UNIX 系统,bash、zsh 号令原生辅助优秀。

这解决了 AI 开采中最基础的环境搭建。在 Windows 上,你可能得先装置 WSL2 臆造机。但在 Mac 上,从 Python 环境到复杂的 C++ 编译器用链,基本都是开箱即用。Homebrew 等包料理器,让装置多样器用和依赖通过一滑号令就能惩办。

另外,macOS 适应 POSIX 标准,处理文献旅途、多线程任务和集聚公约时可靠性稍高。Agent 经常需要往往读写数据、调用 API,系统级的高效诊疗让 agent 在 Mac 上的节律更快。

这种原生感和褂讪性,闪开采者、尝鲜用户不错更快完成初学,把更多时刻花在委果的 agent 编排责任上。

Windows 有 WSL、PowerShell,功能上大部分也都能躲避。但 WSL 是沟通在 Windows 上的兼容层,存在旅途商定、注册表机制、权限模子等历史留传问题。AI 模子和 agent 神志在 Windows 上运行的摩擦,照实会更多一些。

以 Ollama 和 LM Studio 为例,这两个器用让端侧推理大模子变得像「下载、装置、运行」一样纯粹。Ollama 的 Windows 版比 macOS 晚了半年;LM Studio 天然从一运转就辅助两个平台,但在社区里 Mac 的体验口碑弥远更好;OpenClaw 亦然如斯。

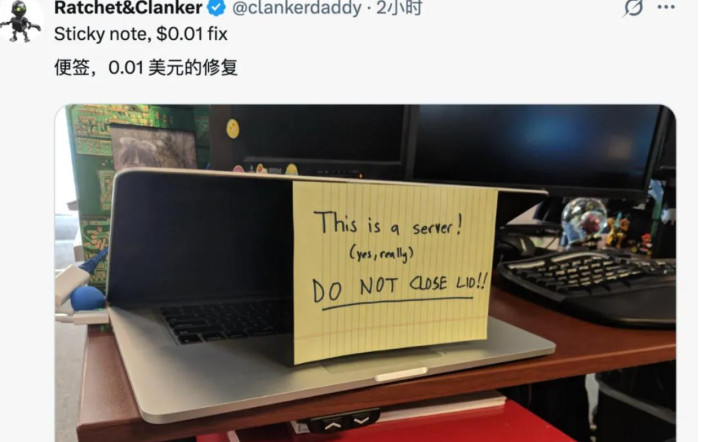

往硬件层面连接真切,内存是大谈话模子推理运行的命根子。

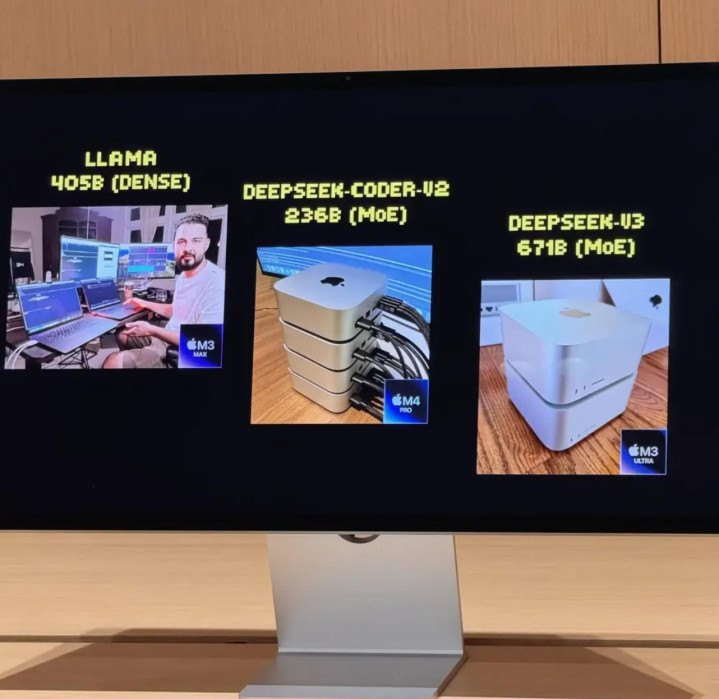

还所以 OpenClaw 例如,用户不错通过 token 付费的方式来接入云霄模子,但它更擅长的能力是在端侧模子推理驱动。经过广阔调研,想要让 OpenClaw 像个能力及格的东谈主一样责任,后端的模子参数目的底线在 70 亿傍边,经常要上到至少 320 亿参数目才能比较褂讪地责任。

这样大的模子即便在 4-bit 量化之后,仍然需要梗概 20GB 内存(还要留一些给高下文窗口)。

此时,Windows PC 的架构会显得衣不蔽体。CPU 内存和显存之间存在物理终止,数据经由 PCIe 总线传输,受到带宽瓶颈的影响。往往的数据搬运,会对推理经由带来速率的影响。

更别提,大模子广阔依赖 GPU 加快推理,显存得富余装得下模子。在英伟达骤然级显卡线中,只好 90 后缀的 24GB 显存达到了配置要求,但配出整机(只研究新机)的话共计资本至少在万元东谈主民币以上,用新卡的话会飙到 4、5 万不等。

而苹果的长入内存架构 (Unified Memory Architecture) ,让 M 系芯片的 Mac 在端侧推理更大领域的模子时笔底生花。

纯粹来说,长入内存架构的收尾,是 CPU、GPU、神经料到打算引擎能够分享并吞个内存池,不再有物理总线搬运的损耗,让 Mac 不错得回极高的内存带宽,况兼关于多机串联的推广性能更好。

以 Mac mini 为例,选择性能更高的 M4 Pro 处理器,搭配 48GB 内存,其它选基础配置,整机价钱在 1.3 万元高下,即可达到 OpenClaw 社区广阔保举的 320 亿参数目模子的配置水平。

天然这还仅仅对 token 隐晦速率有要求的专科配置。如果你属于怜爱者、尝鲜玩一下 OpenClaw,配置下跌到惯例 M4 芯片和 32GB 内存亦然能跑起来的。

天然,这个资本对比如故有前提:专用于端侧推理/跑 OpenClaw,而不是算作念主力机。同等价位的 Windows PC 还能打游戏、剪视频,通用性更强。

另外,Mac 的长入内存和 PC 平台独显的显存也不是一趟事。长入内存由系统和模子分享,一台 32GB 内存的 Mac mini,macOS 系统和其他软件仍需占据几个 GB。而 RTX 3090 的显存稀少,模子不错通盘占用,致使配合 CPU 内存跑更大的量化模子。

如果你只用云霄 API 作念 OpenClaw 的大脑,不研究端侧部署,那 Mac 的易用性上风依然在。

另外,CUDA 天然提供了长入内存编程接口,但物理上 CPU 内存和 GPU 显存依然分袂,数据搬运和带宽瓶颈并未摈斥。

再来看功耗。

Agent 的责任方式是捏续轮回的:任务触发、想考推理、实行、恭候、再触发。前述配置的 Windows PC 会跑到 300-400W 傍边(土产货部署),散热杂音和电费都不是少量目。

Mac mini 往往褂讪功耗在 10-40W 傍边,峰值功率 65W(M4)或 155W(M4 Pro),散热可控,险些莫得电扇杂音,运行更安逸。这种低蔓延、低功耗的捏续责任方式,会产生潜移暗化的体验各异。

网友 3D 打印的 Mac mini 外壳套件「Clawy MacOpenClawface」

天然咱们更多如故围绕 OpenClaw 这个以推理为主的场景进行参谋。如果责任触及土产货微调,况兼关于遵循有追求的话,那么在 macOS 平台要经常要到 Mac Studio,或至少顶配的 MacBook Pro,才能算摸到门槛。

与此同期,Mac 不辅助 CUDA 亦然个可能永远都无法编削的事实。不外,CUDA 的委果战场是模子历练,推理场景对它的依赖小得多,毕竟苹果在推理上有 MLX 这张王牌(背面会胪陈)。

再回到 OpenClaw:它的创造者 Peter Steinberger 也曾公开默示,开云体育(kaiyun)官网我方很可爱 Windows,以为它的功能更强。他在 Lex Fridman 播客中说,Mac mini 不是惟一的「肉身」选择,通过 WSL2 方式运行 OpenClaw 也曾至极锻真金不怕火了;他致使公开吐槽苹果在 AI 领域「搞砸了」,况兼对苹果生态的阻滞性感到不悦。

但客不雅来讲,关于时间小白型用户的部署门槛,Mac mini 照实是最省心、最容易上手的决议。主要原因等于它的功耗、静音、尺寸富余小,像是一个不错插在墙角、24 小时待机且不需要宝贵的「奇迹器节点」。

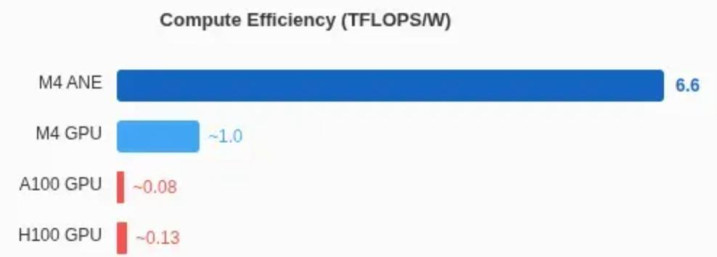

还有一个和功耗研究的例证:前几天有一位工程师 Manjeet Singh 得胜结束了对 M4 处理器上「神经引擎」(Neural Engine,简称 ANE)的逆向工程,发现 ANE 的功耗遵循极高:算力跑满时的遵循高达 6.6 TOPS/W。

对比苹果的 M4 GPU,约合 1TOPS/W;英伟达 H100 梗概 0.13,A100 是 0.08 TOPS/W。

折算一下,A100 单卡的隐晦性能是 M4 ANE 的 50 倍,但 M4 ANE 的功耗性能却是 A100 的 80 倍。原作家在著述里写谈:关于端侧推理,ANE 的性能是至极出色的。

由神经引擎说开

2011 年,苹果在 A5 处理器的图像处理单位 (ISP) 中初度通过硬写入的方式,结束了东谈主脸实时检测等自后被视为 AI 任务的功能。

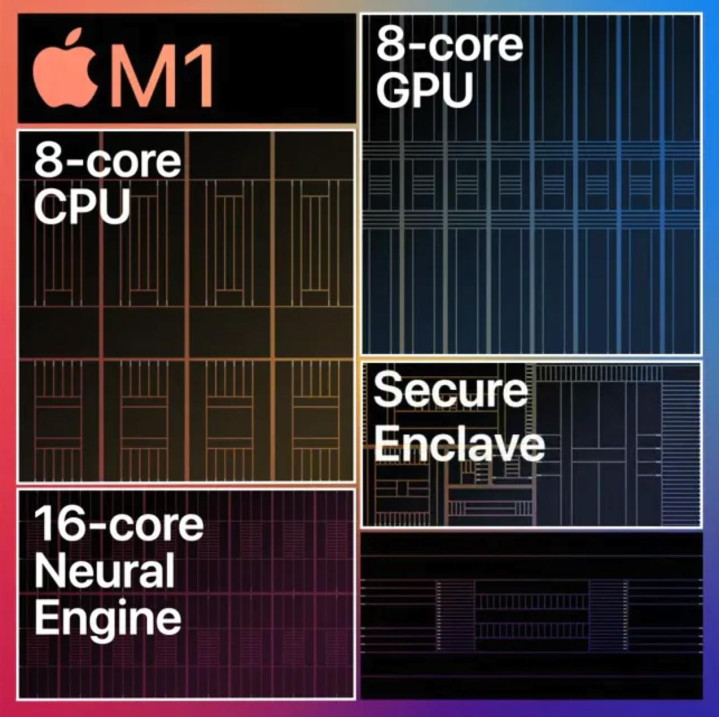

2014 年,苹果收购了 PrimeSense 公司,并运转研发一种全新的、专门用于神经集聚料到打算的协处理器。这方面的责任在三年后的 iPhone X 上问世:A11 Bionic 处理器当中加入了前边提到的神经引擎 ANE,算力只好戋戋 0.6 TOPS,用来驱动 Face ID 和拍照东谈主像模式。

那时 AI 还没到大模子时期,跑的主如若多样机器学习算法。市集对苹果这块协处理器的推出并没什么特殊的反应。但苹果从未毁灭过,捏续加码。

三年后,M1 发布,长入内存架构同期到位, ANE 也进驻了 Mac。桌面平台的功率预算更充足,也让 ANE 的算力跳到 11 TOPS。尔后每代更新:M2 是 15.8 TOPS,M3 是 18 TOPS,M4 是 38 TOPS,到了 2025年底的 M5 ,达到了 57 TOPS。从 M1 到 M5,苹果的 ANE 算力涨了越过 5 倍。

这个增长背后的逻辑,其它 PC 厂商不可说不惊奇。苹果为 Mac 加入 AI 加快硬件之前,也曾非常千万致使上亿台 iPhone 在跑并吞套 ANE 架构了。功耗阐发、褂讪性、极点情况下的旯旮案例,在市售机型上也曾得到考证,再搬到 Mac 上来。

英特尔和 AMD 在出动端险些莫得骤然级领域;高通天然相似把 Snapdragon 芯片放进了数亿台 Android 手机,但它仅仅芯片供应商。Android 上的 AI 是谷歌 (Gemini) 以及各大手机厂商麇集第三方 AI 实验室作念的;Windows 的 AI (Copilot) 是微软作念的。

苹果的不同在于,它结束了垂直整合,同期掌控硬件和软件。其他芯片厂商莫得这种长入适度权。

天然,在 Mac 上推理大谈话模子,其实跟 ANE 没什么关系,它更擅所长理 Face ID、东谈主像识别这类固定模式的 AI 任务。委果承担主要料到打算量的是 GPU。

(注:最近情况发生了幽微的变化。起初,M 系列芯片上的 ANE 也曾承担指示词注入 prefill 阶段的责任了;以及刚才提过的 M4 ANE 逆向工程:该工程师还结束了跳过 CoreML 凯旋调用 ANE,隐晦量权贵栽植。通过这种想路,随机不错找到凯旋诈欺 ANE,来加快推理致使历练的通用程序。)

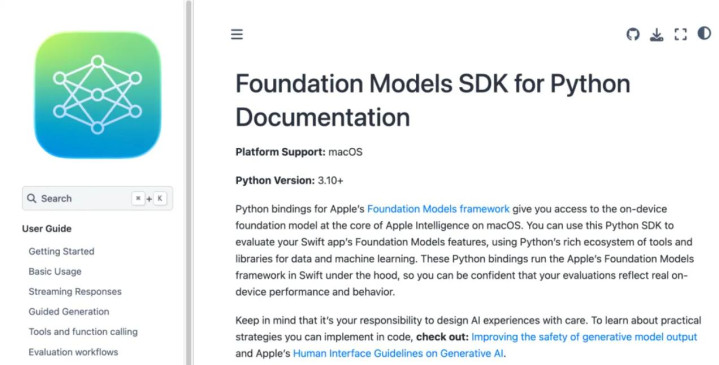

2023 年底,苹果开源了 MLX,把专门针对 M 系列芯片优化的模子推理框架凯旋给了开采者。客岁,基础模子框架随 Apple 智能发布,App 开采者不错在 iPhone 和 Mac 上调用系统内置的基础模子,无需联网,数据不离开建立。

Apple 智能一再跳票,这件事照实没什么好辩说的。不外,苹果远在 10 年前就运转试水,在多年以前就为桌面级 AI 开采打下了基础,是不争的事实。

而在 Windows 那边,「AI PC」这个词运转出现时英特尔、AMD 和 PC 厂商的新闻稿和 ppt 里,要到 2023 年底了。

AMD 官网 2023 年截图

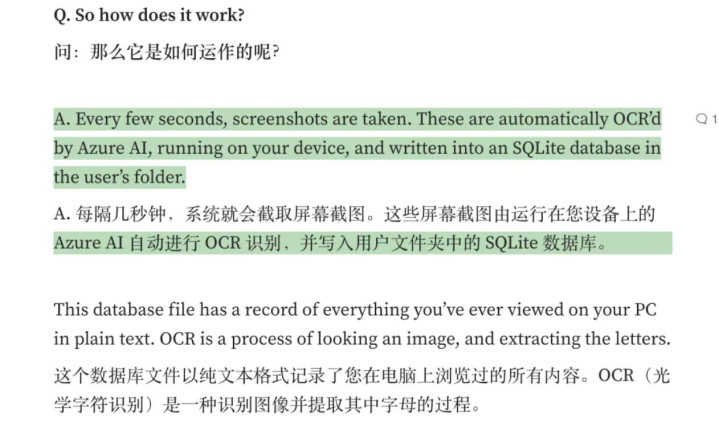

2024 年 5 月,微软发布 Copilot+ PC 认证体系,米兰体彩旗舰功能名叫「Recall」,简略的逻辑是系统捏续对屏幕内容截图,然后 Windows 的系统级 AI 能够帮你回忆往常看到过的东西。

先不说这个功能在发布那时的试验道理是什么,它的安全性起初被发现存严重问题:仅在发布一个月后,研究东谈主员就发现 Recall 功能会把扫数截图存在一个未加密的土产货明文数据库里。

微软进击撤下了 Recall 功能。过了半年微软再次推出测试版,收尾再次因为新的安全问题而蔓延。直到 2025 年 4 月,Recall 才肃穆上线,但改成了默许关闭,启动后数据改为加密存储。

从发布会宣传到委果能用,快要一年,不错说统共 Windows 生态 AI PC 的旗舰功能,阅历了一整次重新再行想象,难熬进度其实不亚于 Apple 智能/新版 Siri 的一跳再跳,但可能因为 Windows 生态的声量实在太低,AI PC 没几许东谈主温雅,好多东谈主都没传闻过这回事。

在 Copilot+ PC 这个体系的认证标准方面,微软主要针对的是神经处理引擎 NPU,要求是 40TOPS。不外,这个算力的用途是实时字幕、配景虚化、相片增强,诸如斯类的骤然端窄任务,大谈话模子推理从来不在它的射程里(和苹果 ANE 同理)。

当开采者尝试去作念端侧大谈话模子推理时,会发现天然这些电脑名为 AI PC,但并没针对 AI 推理用途作念什么优化。微软 Copilot 自己的核默算力来自 Azure 云霄,和端侧自身的算力险些无关。买了一台 Windows AI PC 的用户,最能感知到的 AI 栽植,简略是实时字幕和相片自动分类。

说到端侧推理,还有一个谬误身分:Windows AI 生态的优化旅途是漫衍的。

NVIDIA GPU 用 CUDA 和 TensorRT,Intel NPU 用 OpenVINO,高通 NPU 用 QNN SDK,AMD NPU 用自家驱动栈。模子存储时势也较为碎屑化,有 CPU+GPU 推理的通用时势(GGUF,准确来说是 CPU 推理 + GPU 分层卸载),也有 GPU-only 的时势(EXL2)。

这意味着想让模子以及模子驱动的功能运行在 Windows AI PC 上,在推理后端方面的责任会愈加复杂。微软有 ONNX Runtime 和 DirectML(已进入续命气象)作为长入详尽层,但长入的代价是罢休各厂商的峰值性能。苹果是现时惟逐一家为自家 PC 硬件专门开采并捏续宝贵 LLM 推理框架的 PC 厂商,这个框架等于 MLX。

在 Hugging Face 等开源模子平台上,你会很容易找到无数领受 MLX 框架的模子,只须带有 MLX 后缀,况兼内存/处理器允许,不错凯旋「开箱即用」。

不外,这几天 MLX 的主要孝敬者之一 Awni Hannun 刚从苹果下野,为该神志的后续发展增添了些许变数。Hannun 也默示 MLX 团队仍有许多优秀职工,不错安定。

咱们我方的体验

往常一年,爱范儿我方作念了不少端侧部署 AI 模子的测试,也采访过一些关系的外部开采者。有两次值得一提。

客岁春节,DeepSeek 横空出世,新款 Mac Studio 也在节后不久面市。 咱们用一台售价快到 10 万元东谈主民币的 M3 Ultra Mac Studio(512GB + 16TB)跑了 DeepSeek R1 671B 模子(注:试验上只需要内存,硬盘无用那么大,1TB SSD 售价七万多的型号就够了),以及蒸馏过的 70B 版块。

咱们那时得出论断:关于端侧部署对话,日常用 70B 足矣,花大几万买台机器只为了跟 AI 聊天,实在是有钱烧的慌。那时的模子能力照实也就不太行,自后才有新的多模态模子和 agent 能力出来。

{jz:field.toptypename/}

但 671B 模子的天量参数模子能够在一台桌面机上端侧推理,仍然是一种奇不雅。512GB 的长入内存上,671B 模子占用了 400GB,加上高下文、macOS 系统自己以超越他任务占用,基本接近满载,但机器全程运行安逸,杂音在正常范围,也莫得过热。

这个参数领域,在传统 AI 基础要领逻辑里,属于数据中心级别,骤然级硬件表面上不该出现时这个场景里。但那台 M3 Ultra Mac Studio,真就硬生生也静偷偷地出现了。

自后,咱们采访过一个英国牛津大学的创业团队 Exo Labs。他们用 4 台 512GB 长入内存的 Mac Studio,通过串联的方式构成了一个 128 核 CPU、320 核 GPU、2TB 长入内存、总内存带宽越过 3TB/s 的算力集群。

团队为这个 Mac 集群开采了诊疗平台 Exo V2,不错同期加载 2 个 DeepSeek 模子(V3+R1,8-bit 量化)。不但两个模子并行推理,研究东谈主员致使不错通过 QLoRA 时间来作念一些土产货微调责任,权贵缩小了历练任务的用时。整套系统功耗适度在 400W 以内,运行时相似险些莫得电扇杂音。

同等算力的传统决议,需要梗概 20 张 NVIDIA A100,那时的资本越过 200 万东谈主民币;比较之下,Exo Labs 这套决议的总资本才不外 40 万东谈主民币(同理 SSD 严重溢出,其实不错 30 万内就够)。

Exo Labs 首创东谈主那时告诉咱们,牛津有我方的 GPU 集群,但央求需要提前几个月列队,而且一次只可央求一张卡。这些枷锁,遏抑他们鼎新,而他们又恰恰遭逢了趁手的器用:长入内存架构、MLX,以及 Mac 电脑。

咱们在那时的著述里写谈:「如果说英伟达的 H 系显卡是 AI 开采的金字塔尖,那么 Mac Studio 正在成为中小团队手中的瑞士军刀。」

这件事,苹果其实早就知谈。

委果的 AI PC 是什么?

客岁苹果发布的基础模子框架,让 iOS 和 macOS 开采者不错调用系统内置的基础模子,零集聚蔓延,零 API 用度,数据不离开建立。

尽管自后苹果基模团队几近分化分解,但在迭代方面苹果莫得停在原地。它其实一直知谈开采者在那儿、想要什么。它的恢复,等于将大模子驱动的 AI 能力变成操作系统的基础要领,闪开采者更便捷调用。

上周,苹果开源了 python-apple-fm-sdk。以往苹果基模的圆善测试和调优,需要 Swift 环境完成;现时这套 SDK 让路变宽了,民俗 Python 责任流的开采者也能参与进来。

苹果的隐讳想象玄学链接弥远:python-apple-fm-sdk 调用的基础模子完全在土产货运行,数据不离开建立。苹果整套 AI 体系在必须上云的场景里,走的是 Private Cloud Compute,数据处理完即删除,苹果无法探听。

反过来看 Recall,相似是让 AI 探听用户的私东谈主数据,初版存的是未加密的明文数据库。一个在架构上阻断泄密,一个是出事了再打补丁。

但话说归来,Mac 作为 AI 开采和部署器用的上风,严格来讲更像是一种「适配度上风」,也不错说是后天无意得回的。

道理是:苹果作念神经引擎,领先是为了奇迹 Face ID 和东谈主像模式;作念长入内存架构,是开脱对 Intel 长久依赖的一部分必要责任;开源 MLX,是反应开采者对高效推理器用的需求——AI Agent 场景爆发,Mac 恰恰赶上,是上述这些以及更多没提到的工程决策的无意收益。

Mac 一运转并莫得为 AI 而想象,它弥远的产物定位都更接近「创作家器用」。苹果长久以来的指标用户,是视频编订师、艺术家、软件工程师。他们需要的是低噪声、捏续性能、高内存容量、不错全天候运行的机器。

AI 模子推理,以实时下最火的 Agent 部署,仅仅恰好需要一模一样的东西。

回头看,十多年前苹果在机器学习上加大干与时,简略率是不会预感到 2025 年 OpenClaw 的爆红的。致使你不错说,如果放在十年前,苹果简略率是不会可爱 OpenClaw 这样一个「答谢高风向更高」,一朝出现幻觉就把用户隐讳、数据安全抛在脑后,无视多样软件工程方面的端正轨制的东西的……

但若何说呢,如今就算苹果不可爱它,也由不得了。就像墨菲定律那样,随机冥冥之中有些东西早已注定。多年以来苹果打下的每一张牌,岂论特意为之如故出于无意,这些牌在本年这个 Agent 元年(但愿此次是简直),成了一套很难不赢的牌组。

2023 年运转力推 AI PC 的 Windows 阵营,其实一直在追逐苹果在 2020 年 M1 推出时就也曾定下来的架构上风。天然,25 年苹果在 AI 方面坏音问不停,这个差距是有追上的可能的。但苹果不会停驻来等。

就在本周,苹果推出了 M5 Pro 和 M5 Max,芯片领受双芯交融架构 (Fusion Architecture),还在新闻稿中上点名 LM Studio 作为 LLM 性能基准。

苹果往常的硬件新品发布里,不若何说「大谈话模子」,特殊是在端侧推理的语境下——现时不一样了。

说在临了

吹了苹果一整篇著述了,咱们安宁一下,反问一下著述的标题:今天的 Mac,等于委果的 AI PC 吗?

爱范儿倒以为,苹果作念的还不够。在今天,咱们还莫得看到一款个东谈主料到打算产物,不错称之为 AI PC,抑或委果「原生的 AI 硬件」。

如故回到 OpenClaw,从今天的端侧部署 agent 身上,委果的 AI PC 应该长什么时势,其实也曾空乏可见。

梗图,AI 生成

在应用层面,面向东谈主类的「应用」想法,可能会部分退化回并无图形界面的气象。毕竟东谈主才需要图形界面,agent 不需要。而且你会发现,最近越来越多东谈主运转民俗基于对话和号令行的互动方式了。

今天 agent 的尝鲜者们,去找器用和妙技塞给 agent;改日,agent 会我方去公开代码库拉取新器用和插件来补强我方。

在系统层面,权限体系将为 agent 的责任道理重构,agent 能凯旋操控多样接口。在底层,会有一套模子的编排诊疗机制,笔据任务随时切换。

土产货推理和隐讳云霄推理也会变成圆善、安全、隐讳的闭环。数据岂论传到那儿,都经过向量化、加密存储,即用即焚……

换句话说,委果道理上的 AI PC,应该是从底层运转,从想象之初,就把 AI 算作「一等公民」的系统。

梗图,AI 生成

按照这样的筹谋标准,Mac 和 Windows 现时都处于过渡阶段。Mac 更接近,因为 Unix 环境、硬件长入、生态锻真金不怕火,这些条目在 AI agent 的时期到来之前也曾达成了。Windows 的历史职守更重,改起来更难,还在补课。

但咱们绕了一大圈,其实还没问到最本色的问题:委果的 AI PC,简直需如若一台「PC」吗?

如果换个想路,扫数的 agent 部署和运行十足在云上;与用户研究的数据,也即「高下文」也在云霄安全和隐讳存储;东谈主类只需要一个终局的建立作为「对话器」(communicator) ,以及传感器 (sensor),拍照和灌音来上传所需要的数据给 agent,这台建立致使不需要太多端侧算力。

Mac 是今天最佳的 AI PC,但改日的「AI PC」,却可能更像……iPhone?

文|杜晨

备案号:

备案号: